Rejtett veszélyek a szervezetben

A vállalati alkalmazottak gyakran saját hatékonyságuk növelése érdekében kezdenek el mesterséges intelligencia eszközöket használni, anélkül, hogy erről az IT-részleg tudna. Ez a spontán innováció segítheti a napi munkát, ugyanakkor adatbiztonsági és működési problémákhoz is vezethet. “Az IT által nem jóváhagyott MI-eszközök használata adatvédelmi kockázatot hordoz, megbízhatatlan döntésekhez vezethet, és akár sértheti az EU AI Act, illetve a GDPR előírásait” – hangsúlyozta a szakértő.

Szabályozás és a vállalati felelősség

Az Európai Unió Mesterséges Intelligencia Rendelete (EU AI Act) az első átfogó szabályozás, amely pontos iránymutatást ad arra vonatkozóan, hogy a vállalatoknak milyen előírásokat kell betartaniuk a mesterséges intelligencia rendszerek fejlesztése, forgalmazása, importálása vagy használata során. “A rendelet átláthatóságot követel meg, különösen a generatív AI-rendszereknél, szigorú adatvédelmi elvárásokat fogalmaz meg, hogy minimalizálja az adatszivárgás esélyét, valamint súlyos szankciókat helyez kilátásba, ha egy vállalat nem követi a szabályokat” – mondta Dalos-Kovács Gabriella.

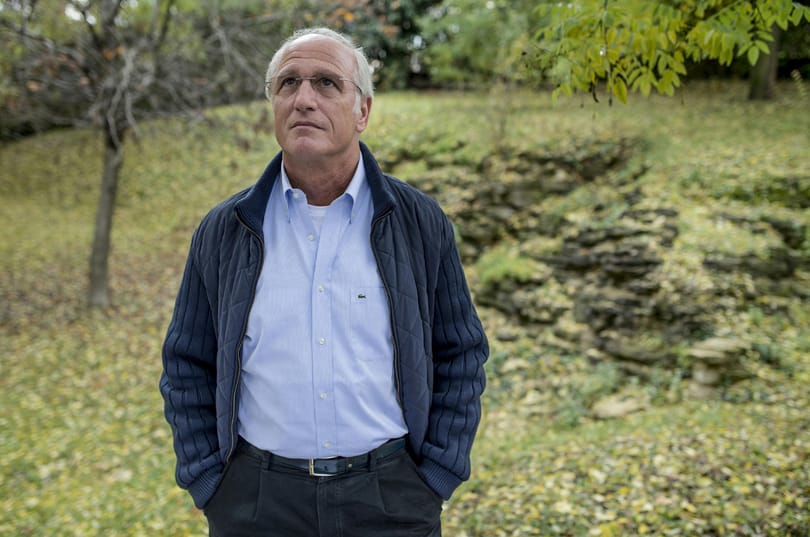

Dalos-Kovács Gabriella AI Officer & Strategist

4iG Group

Az EU AI Act előírásainak való megfelelés leghatékonyabb módja egy belső MI irányítási keretrendszer (AI governance framework) kialakítása. Ez egyrészt biztosítja az MI eszközök biztonságos és szabályos használatát, másrészt – a jogszabályi követelmények teljesítése mellett –, erősíti a vállalat piaci pozícióját és növeli ügyfelei bizalmát.

A humán tényező szerepe

A szakértő szerint Shadow AI elleni küzdelem kulcsa a technológiai és jogi szabályozáson túl a kollégák tudatosságának növelésében rejlik. Ha ők tisztában vannak a mesterséges intelligencia használatának kockázataival és a felelős alkalmazás jelentőségével, úgy megelőzhető az ellenőrizetlen eszközök használata. Ehhez belső tematikus oktatási programok szükségesek, amelyek az AI Act vállalati megfelelés követelményeit, információbiztonsági előírásokat és irányelveket ismertetnek.

“A munkavállalók oktatása és tudatosságának növelése mellett a vállalatoknak érdemes összeállítaniuk egy MI használati szabályzatot is, amely egyértelműen meghatározza, milyen eszközöket és hogyan használhatnak a munkavállalók” – mondta a 4iG szakértője.

Kontroll helyett lehetőség

A vállalatoknak tehát nem az MI eszközök tiltására kell fókuszálniuk, hanem arra, hogy egy jól átgondolt MI irányítási keretrendszerrel, egyértelmű vállalati stratégiával és használati szabályzattal biztonságos, megbízható eszközhasználatot tegyenek elérhetővé a munkavállalóik számára. Érdemes olyan mesterséges intelligencia-eszközökre előfizetniük, amelyek megfelelnek a jogszabályi előírásoknak és garantálják az adatbiztonságot. Dalos-Kovács Gabriella kiemelte, hogy ez nemcsak a hatékony munkavégzést támogatja, hanem egy stabil alapot is nyújt ahhoz, hogy a dolgozók magabiztosabban mozogjanak a mesterséges intelligencia terjedésének egyelőre még ingoványos talaján.

A tartalom a 4iG Group megbízásából, a HVG BrandLab közreműködésével készült. A cikk létrehozásában a HVG hetilap és a hvg.hu szerkesztősége nem vett részt.